引言:当 AI 需要隔离的”工作区”

读完这篇关于 AI 智能体沙箱技术的深度探讨,我感受到一种前所未有的清醒。文章的核心观点令人深思:AI 智能体需要隔离”工作区”(沙箱)以安全执行代码而不损害宿主系统。

这不是简单的技术问题,而是 AI 安全的根本性挑战。当 AI 能够执行代码时,如何确保它不会造成破坏,成为我们必须面对的问题。

智能体执行代码的风险:为什么需要沙箱?

文章首先探讨了 AI 智能体需要隔离”工作区”的迫切需求。这让我思考一个问题:为什么 AI 智能体需要沙箱?

执行代码的风险:

- 恶意代码:AI 可能生成恶意代码,破坏宿主系统

- 资源滥用:AI 可能滥用系统资源,导致系统崩溃

- 数据泄露:AI 可能访问敏感数据,导致数据泄露

- 权限提升:AI 可能尝试提升权限,获得更多控制权

这些风险不是理论上的,而是实际存在的。当 AI 能够执行代码时,它就像一个不受控制的程序,可能造成严重的破坏。

沙箱的意义在于:为 AI 提供一个隔离的执行环境,限制其权限,防止其造成破坏。

模式 1:智能体在沙箱内

文章正式提出了两种主要的集成模式,第一种是”智能体在沙箱内”。

模式 1 的架构:

- 智能体驻留在沙箱内部

- 沙箱提供隔离的执行环境

- 智能体在沙箱内执行代码

模式 1 的优势:

- 开发体验好:类似于本地环境的开发体验

- 性能高:智能体直接在沙箱内执行,无需网络通信

- 延迟低:没有网络延迟,响应速度快

模式 1 的风险:

- API Key 泄露:智能体可能泄露 API Key

- 知识产权外泄:智能体可能将敏感代码发送到外部

- 数据泄露:智能体可能访问沙箱外的数据

这种模式的核心问题在于:智能体在沙箱内,但沙箱不是完全隔离的。智能体可能通过 API 调用、网络通信等方式,泄露敏感信息。

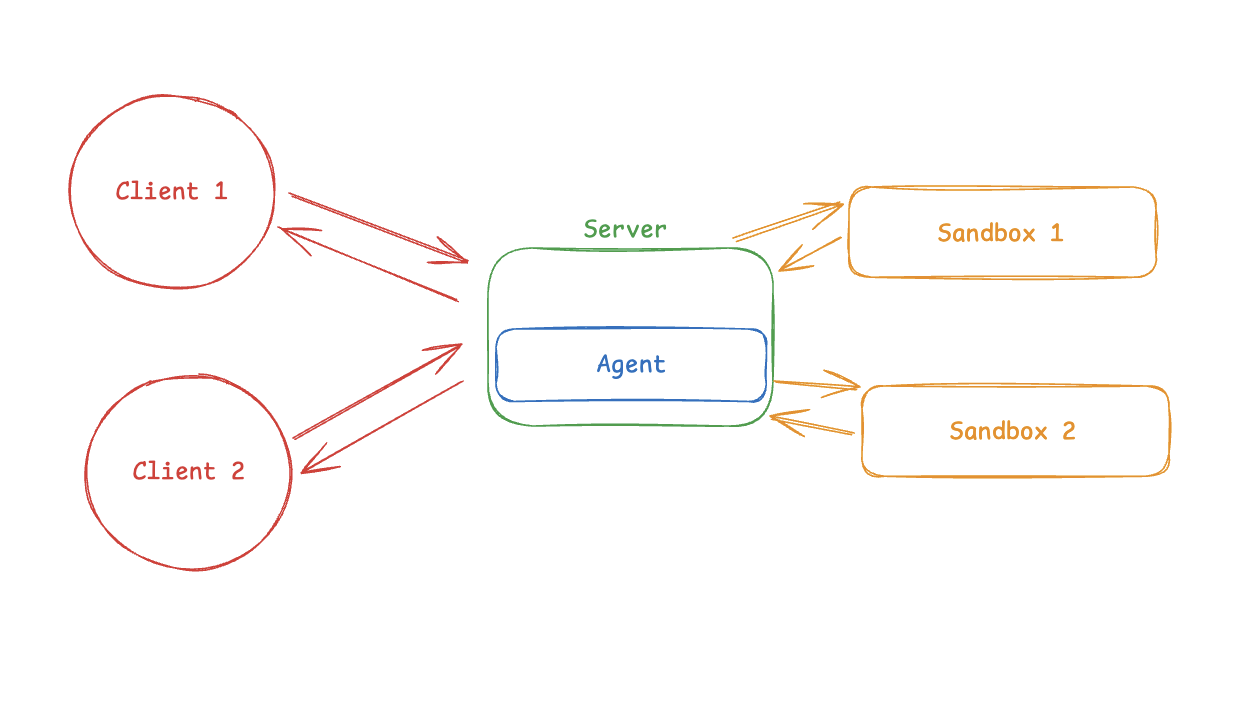

模式 2:沙箱作为工具

第二种模式是”沙箱作为工具”。

模式 2 的架构:

- 智能体在外部运行

- 沙箱作为工具,通过 API 调用

- 智能体通过 API 调用沙箱执行代码

模式 2 的优势:

- 更快的迭代:智能体在外部,可以快速迭代

- 更好的凭据安全性:API Key 存储在外部,不泄露给智能体

- 推理与执行的清晰分离:智能体负责推理,沙箱负责执行

模式 2 的挑战:

- 开发体验差:需要通过 API 调用,开发体验不如本地环境

- 性能较低:需要网络通信,性能较低

- 延迟较高:有网络延迟,响应速度较慢

这种模式的核心优势在于:推理与执行的清晰分离。智能体在外部,不直接执行代码,降低了安全风险。

两种模式的对比:如何选择?

文章对比了两种模式,让我对如何选择有了清晰的认识。

选择模式 1 的场景:

- 需要本地开发体验

- 对性能要求高

- 对延迟敏感

- 可以接受一定的安全风险

选择模式 2 的场景:

- 需要更高的安全性

- 需要更快的迭代速度

- 需要清晰的推理与执行分离

- 可以接受一定的性能损失

这两种模式没有绝对的优劣,关键在于根据具体需求选择合适的模式。

耦合度、安全性和速度:三个核心权衡

文章指出,选择合适的架构需要考虑对耦合度、安全性和速度的具体需求。这三个因素是相互制约的。

耦合度:

- 模式 1:智能体在沙箱内,耦合度高

- 模式 2:智能体在外部,耦合度低

安全性:

- 模式 1:智能体在沙箱内,安全性较低

- 模式 2:智能体在外部,安全性较高

速度:

- 模式 1:智能体直接执行,速度快

- 模式 2:需要网络通信,速度慢

这三个因素的权衡,是选择架构的核心。没有完美的架构,只有最适合的架构。

deepagents 框架:实际实现示例

文章最后给出了使用 deepagents 框架的实际实现示例。这个示例让我对如何实现沙箱技术有了具体的认识。

deepagents 框架的核心功能:

- 沙箱管理:自动创建和管理沙箱

- API 封装:提供简洁的 API 调用接口

- 安全隔离:确保沙箱与宿主系统的隔离

- 资源限制:限制沙箱的资源使用

这个框架的意义在于:降低了沙箱技术的实现难度,让开发者可以快速集成沙箱功能。

深度思考:沙箱技术的本质是什么?

读完这篇文章,我一直在思考一个问题:沙箱技术的本质是什么?

第一,不是简单的隔离。沙箱技术不仅仅是隔离执行环境,更是对 AI 能力的限制和约束。

第二,不是完全的安全。沙箱技术可以提高安全性,但无法保证绝对安全。AI 仍然可能通过其他方式造成破坏。

第三,不是一劳永逸的解决方案。沙箱技术需要持续维护和更新,才能应对新的安全威胁。

沙箱技术的本质是:在 AI 的能力和安全性之间找到平衡。既让 AI 能够执行代码,又限制其权限,防止其造成破坏。

实践启示:如何构建安全的 AI 智能体?

作为从业者,我们需要思考如何构建安全的 AI 智能体。

第一,使用沙箱技术。为 AI 智能体提供隔离的执行环境,限制其权限。

第二,选择合适的架构。根据具体需求,选择”智能体在沙箱内”或”沙箱作为工具”架构。

第三,实施多层防护。除了沙箱,还需要实施代码审查、安全扫描、权限控制等多层防护。

第四,持续监控和审计。监控 AI 智能体的行为,审计其执行记录,及时发现异常。

第五,建立应急响应机制。当 AI 智能体出现异常时,能够快速响应,限制其影响。

这些措施不能保证绝对安全,但可以大大降低安全风险。

总结:沙箱技术是 AI 安全的最后一道防线

这篇文章让我深刻认识到,沙箱技术是 AI 安全的最后一道防线。当 AI 能够执行代码时,沙箱技术是防止其造成破坏的关键。

作为从业者,我们需要:

- 理解沙箱技术的必要性:认识到 AI 执行代码的风险,理解沙箱技术的重要性

- 选择合适的架构:根据具体需求,选择”智能体在沙箱内”或”沙箱作为工具”架构

- 权衡耦合度、安全性和速度:在三个因素之间找到平衡,选择最适合的架构

- 使用成熟的框架:使用 deepagents 等成熟框架,降低实现难度

- 实施多层防护:除了沙箱,还需要实施其他安全措施,构建多层防护体系

沙箱技术不是万能的,但它是 AI 安全的基础。只有建立了安全的沙箱环境,才能让 AI 智能体安全地执行代码,发挥其价值。

来源:智能体连接沙箱的两种模式