金句开头:AI 真正拉低效率的时刻,不是在它「不够聪明」的时候,而是在我们「不愿意好好给它设计工作」的时候。

一、那些让你怀疑人生的瞬间,其实很典型

如果你已经在工作中试着用 AI,一定经历过类似的画面:

- 想让它改个小需求,结果返回一坨完全不贴上下文的代码;

- 想让它写个 SQL,字段名、表名全乱,改到最后不如自己从头写;

- 想让它帮忙写一页文案,反复几轮都像「格式正确的废话」;

- 想自动生成测试用例,结果跑不过、覆盖率还不如自己手写几条。

那一刻你心里会冒出一句话:

「算了我自己写吧,和它折腾的时间早干完了。」

但如果你冷静拆一下,会发现一个残酷的事实:

绝大部分「AI 不如自己写」的时刻,本质上不是 AI 的问题,而是我们给它的「任务定义」太烂。

二、AI 最怕三种任务:模糊、混装、甩锅

1. 模糊:连你自己都说不清楚要什么

很多时候,我们给 AI 的任务是这样的:

- 「帮我重构下这个模块,让它更优雅一点」

- 「把这段文案改得有说服力一点」

- 「帮我优化下这个 SQL 性能」

问题是,「更优雅」「更有说服力」「更快」在不同人脑子里含义完全不一样。 你在心里有一个隐含标准,但从来没说清楚。

当任务定义是模糊的,AI 只是把你的模糊扩大成了一屏输出。

2. 混装:一口气塞一堆不同类型的要求

还有一种常见提问方式:

- 「帮我理解这段代码、找出 bug、顺便重构一下,再帮我写测试和文档。」

对人类来说,这是连续的几个步骤; 对 AI 来说,这是一条「结构混乱的指令」:

- 它不知道该优先干啥;

- 也不知道每一步的「Done 标准」是什么。

结果就是:四件事全做了点,但哪一件都不让人放心。

3. 甩锅:把本该自己判断的事扔给 AI

更隐蔽的一种情况是: 我们把自己不想面对的「决策」扔给 AI:

- 「你帮我选一个最好的技术方案」

- 「你帮我决定这个功能要不要做」

- 「你帮我评价这段代码写得好不好」

这些问题本质上都高度依赖你的上下文、团队现状、业务取舍。 AI 没法替你承担这些责任,它给出的只是一个「看起来合理」的意见。

当你想用 AI 替你做「你自己都没想明白」的决定时, 它当然「还不如你自己写」。

三、真正应该交给 AI 的,是哪一类工作?

我逐渐发现,有三种任务,交给 AI 划算到离谱:

1. 高重复、低判断

比如:

- 批量生成接口文档草稿;

- 为一堆函数补上注释;

- 根据现有代码生成初始测试用例;

- 把日志 / 异常堆栈整理成可读报告。

这类任务的特点是:

- 规则清晰;

- 好坏标准容易定义;

- 人类做起来很烦,但并不难。

这就是 AI 的甜蜜区:你负责设定规则,它负责机械执行。

2. 高信息量整理,而不是高精度决策

比如:

- 把一个长 PR 的变更点总结出来;

- 把几段需求讨论梳理成一份「决策备忘」;

- 把多个方案的优缺点汇总到一张列表。

决策权依然在你手上,但信息整理这一步完全可以交给 AI。

你不再需要从头到尾啃文档,而是可以在「结构清晰的摘要」之上做判断。

3. 用来「试探性探索」,而不是「最终实现」

比如:

- 让 AI 先帮你写一个「能跑的垃圾版本」,你再手工重构;

- 让它先写出几套不同风格的 API 设计,你选一套再优化;

- 让它生成几组不同角度的错误提示文案,你挑最顺眼的那组。

这时候 AI 更像一个「头脑风暴助理」, 帮你快速看到几个可能的方向,而不是直接产出终稿。

用它来「试错」和「扩展视野」,远比用它来「代替最终实现」靠谱得多。

四、让 AI 真正变好用,只需要三个小习惯

如果你已经有「交给 AI 还不如自己写」的挫败感,可以从这三件小事开始改:

1. 所有任务都先写一句「成功标准」

在每次开口前,先问自己一句:

「我怎么判断,它完成得好不好?」

然后把这个标准,翻译成 1–3 条具体的判断条件写进指令里。 哪怕是简单的:

- 「必须兼容现有这两个接口」

- 「不能引入新依赖」

- 「复杂度不能超过现在一倍」

这样 AI 至少知道,要往哪个方向优化。

2. 一次只让它做一件事

把「理解代码」「找问题」「提方案」「改代码」拆成几轮,而不是一口气全甩过去。

这不只是对 AI 友好,对你也好—— 你能在每一轮中逐步校正方向,而不是最后一次性发现「全跑偏了」。

3. 给自己写一份「AI 协作手册」

把你在工作中试出来的好 Prompt、好流程、好套路, 统一记在一个文档里(就像我们现在做的 SKILL-DIRECTORY)。

久而久之,你会发现:

- 你在用的已经不是「某个模型」,而是一套「方法论」;

- 换模型也没关系,因为你的协作方式是稳定的。

这时候,AI 才真正从「会时不时气死你」的玩具,变成「你可以信任的搭档」。

AI 解读

1. 问题抽象 原问题看似是在吐槽 AI 的不稳定输出, 实质是在问:

「在哪些任务上,用 AI 天然吃亏?我该如何调整使用方式?」

这篇文章没有停留在「罗列几个失败案例」的层面,而是:

- 先从任务定义和协作方式上拆因子(模糊、混装、甩锅);

- 再反向总结出「适合 AI」「不适合 AI」的任务特征;

- 最后给出三个可马上实践的小习惯。

2. 与 Skill 体系的对应关系 文章隐含对应了你已有的 Skill 设计:

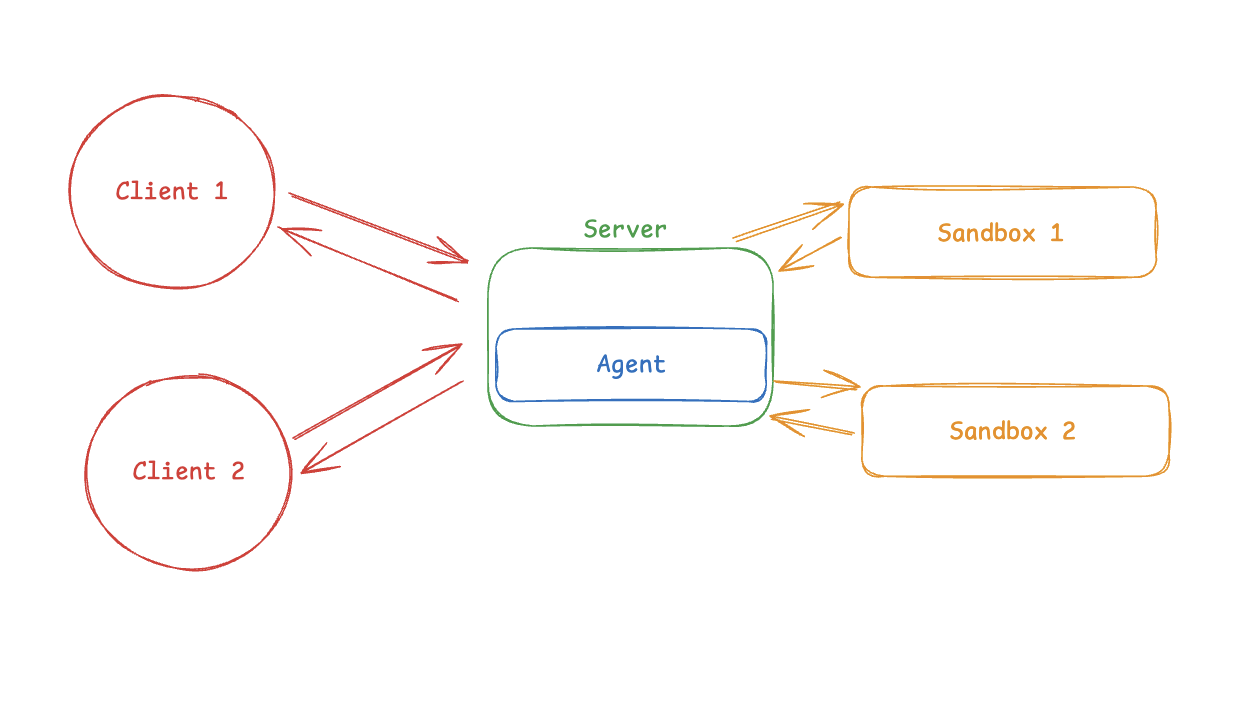

skill.claude.workflows.designer- 用「工作流」的方式限制 AI 的职责和节奏;

skill.openclaw.runtime.guard- 在长时任务中给 AI 行为加一道「守门员」;

skill.blog.from-node- 把「写多篇博客」从手工任务,收敛成一个可复用的批处理 Skill。

这些 Skill 的共同点是: 不再把 AI 当成一个「万能回答器」,而是当成一个「被系统约束的执行组件」。

3. 可扩展方向 如果你后面继续写系列文,可以考虑:

- 写一篇专门拆解「真实失败用例 + 对应 Skill 改造前后对比」;

- 在 OpenClaw / 自己的工具里,把文中三条小习惯固化成一个「AI 协作 Checklist Skill」,每次调用前自动走一遍检查。

来源: 知乎问答:工作中,有哪些瞬间让你觉得「把任务交给 AI 还不如自己写」? https://www.zhihu.com/question/2004183228873974976/answer/2008171738723263109